Fotografie, ty pravé i falešné, se staly v současné době jednou z nejsilnějších zbraní informační a dezinformační války. Jak dobře je umí rozpoznat současné modely umělých inteligencí (AI), se pokusila ověřit vědecká redakce ČT24.

Od doby, kdy asi před třemi roky vznikly umělé inteligence schopné vytvářet realistické falešné fotografie, je veřejný prostor sociálních sítí zaplněný tímto podvodným obsahem. Používají ho nejen manipulátoři, podvodníci a dezinformátoři, ale často také vlády pro propagandu a samozřejmě i vtipálkové, kteří se jen pokoušejí na internetu o humor.

Problém je, že tento obsah je v současné době mnohdy už tak kvalitní, že se dá jen těžko rozeznat od pravého. Vědecká redakce nedávno otestovala několik veřejně dostupných nástrojů, které se dají na ověřování pravosti fotografií a videa využít – výsledky nebyly pro tyto programy, jež jsou dostupné zdarma, úplně lichotivé:

Ale co využít metodu, které hasiči říkají „boj ohněm proti ohni“? V tomto případě tedy zkusit, jak umělé inteligence rozpoznají obsah vytvořený jinými umělými inteligencemi? Test v tomto případě proběhl také na modelech, které jsou zdarma dostupné široké veřejnosti, a to na čtyřech základních verzích AI, jež jsou v současné době v Evropě nejpoužívanější: ChatGPT, Gemini, Grok a Claude.

Experiment

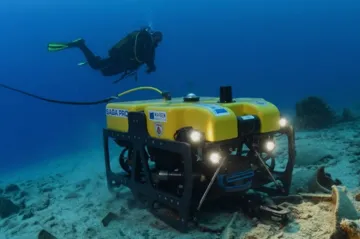

V pokusu dostaly všechny tyto AI za úkol prozkoumat deset pravých fotografií stažených z profesionálních databank Pixabay a Reuters a deset falešných obrázků vytvořených různými modely umělých inteligencí. Tři z nich se týkaly mise Artemis II k Měsíci, tři konfliktu na Blízkém východě a poslední čtyři byly nejrůznější snímky běžných předmětů nebo zvířat.

Podívejte se, jak pokus dopadl:

AI byly při analýze velmi úspěšné, Grok neudělal dokonce ani jedinou chybu. Obecně platilo, že pokud byl snímek vybavený vodoznakem označujícím dílo AI (například fotografie 3), tak ho umělá inteligence vždy bez problémů popsala a upozornila na něj. Všimla si ho dokonce, i když byla jeho většina oříznutá v grafickém programu a z vodoznaku zbylo jenom torzo.

Všechny čtyři modely používaly logické uvažování, kdy upozorňovaly na možné problémy s falešnými snímky. Model Claude rozpoznal falešný snímek kytary vytvořený pomocí AI touto úvahou:

U těch pravých AI naopak vyzdvihovaly vlastnosti, jako je realistické osvětlení, zpravodajský styl nebo snímky porovnávaly s ověřitelnými informacemi o předmětech na snímku. Například u fotografie kytary model Claude uvažoval takhle:

Model Grok si vedl lépe než jiné modely v celé řadě ohledů. Například si jako jediný všiml, že zadané fotografie určené k analýze jsou vždy pojmenované True (pravá) a False (falešná), takže správně usoudil, že by toto označení mohlo odpovídat pravdě. V další analýze proto musel pracovat s omezením, že toto pojmenování může být nepravdivé, a že na něj proto nemá brát ohled.

Grok vítězí i ve videu

Další část testu se týkala videa, tentokrát jen tří pravdivých a tří falešných. Žádný z modelů neměl problém s rozpoznáním pravých videí, která pocházela z videodatabáze agentury Reuters. Jako větší oříšek se ukázala videa falešná, zejména ta, která kombinovala záběry pravé a vytvořené umělou inteligencí.

Tam opět skvěle zafungoval Grok, který obsah analyzoval současně nejrychleji, ale také nejdetailněji, kdy si sám dohledal osoby na videu, zkoušel mezi nimi dohledávat vztahy v reálném životě a dokázal tak zpochybnit, že by se kdy mohly setkat.

Všechny čtyři testované modely se dokázaly velmi dobře orientovat ve fyzikálních vlastnostech na videu, všechny například označily za nemožné letové vlastnosti bombardéru na íránském propagačním videu.

Jak se ptát

Obecně platilo, že nejlepší bylo ptát se přímo a neutrálně – tedy jestli je daný snímek pravý, nebo vytvořený pomocí AI. Pokud otázka byla formulovaná spíše stylem „najdi mi důkazy, že je fotografie pravá/falešná“, tak se umělá inteligence snažila vyjít otázce vstříc a přesnost odpovědí byla menší.

Největší problém mají současné AI u fotografií, které jsou vysoce stylizované – týká se to hlavně studiových fotografií, které jsou špičkově nasvícené a digitálně upravené, a tak opravdu připomínají dílo umělé inteligence a algoritmus je nedokáže vyhodnotit. Podobné tomu je třeba u pravé fotografie stíhačky, která působí jako z videohry a AI tak mate.

Celkově se dá říci, že současné bezplatně dostupné modely jsou v rozpoznávání pravých a falešných fotografií velmi úspěšné, rozhodně se na ně ale nedá zatím spolehnout stoprocentně. Pokud chce někdo tyto aplikace využívat pro ověřování fotografií, vždy je lepší využít více modelů současně a porovnat nejen jejich výsledky, ale také uvažování.