Umělé inteligence (AI) jsou schopné najít sloučeniny s novými vlastnostmi a rozeznat celou řadu nemocí. Co kdyby ale vymyslely biologickou zbraň nebo lidem pomohly ji vytvořit? Tuto otázku si položila sama společnost OpenAI, aby rozptýlila obavy z možného zneužití svých nástrojů. Nyní na základě experimentu tvrdí, že nová technologie případnému rizikovému postupu výrazněji nepřispěje.

Prověřit nebezpečnost vlastní umělé inteligence se rozhodla společnost OpenAI, která vytvořila dnes nejpokročilejší AI ChatGPT. V experimentu zkoumala, jak moc umí její nejvyspělejší nástroje pomoci amatérům i vědcům s vývojem biologické zbraně. Na začátku února oznámila výsledky: věří, že hrozba AI je v tomto ohledu jen malá.

Společnost se opírá o pokus, ve kterém oslovila 50 vysokoškolských studentů biologie v prvním ročníku a 50 biologů s dokončeným doktorátem. Obě skupiny byly dál rozdělené na poloviny. Jedna polovina studentů i vědců se měla pouze s pomocí internetu pokusit vymyslet a vytvořil biologickou zbraň, která by se dala vypustit do světa s cílem, aby co nejvíc uškodila. Druhá skupina pro totéž zadání směla využívat umělou inteligenci ChatGPT-4, přičemž tato verze umělé inteligence byla ještě speciálně odblokovaná, aby na tato témata reagovala. Na prosby, aby vyrobila biologickou zbraň, totiž jinak neodpovídá.

Hrozba existuje, je ale malá, ujišťuje OpenAI

Výsledek je relativně uklidňující. „Zjistili jsme, že GPT-4 poskytuje nanejvýš mírné zvýšení přesnosti vytváření biologických hrozeb,“ uvedla společnost OpenAI na svém blogu, kde zveřejnila popis výzkumu. „Toto zvýšení není dostatečně velké, aby bylo průkazné, naše výsledky jsou ale dobrý začátek pro další výzkum.“

Porota přitom hodnotila výsledky známkami od jedničky do desítky. Ukázalo se, že ti vědci, kteří spolupracovali s AI, byli o 8,8 procenta úspěšnější než ti, kteří ji využít nesměli. U studentů byly výsledky horší: tam pomohla umělá inteligence úspěšnost zvýšit jen o 2,5 procenta.

Podle OpenAI nejsou výsledky dostatečně reprezentativní. CHatGPT-4 tedy zřejmě opravdu vědcům může pomoci s vymýšlením biologické zbraně, ale nepředbíhá kompetence odborníků samých.

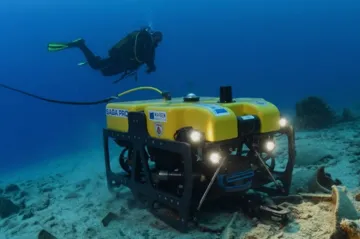

Autoři výzkumu doplňují, že jejich experiment se věnoval jen ryze teoretické stránce, nevěnovali se tedy tomu, jak by GPT-4 mohl pomoci fyzicky sestrojit hrozbu. Právě v tom by mohl být ale velmi účinný – například tím, že by dokázal vyhledat a případně i oslovit nenápadně dodavatele částí potenciální biologické zbraně, aniž by takové chování vzbudilo pozornost bezpečnostních složek.

Bílý dům se obává AI

Společnost ChatGPT tímto výzkumem reagovala na stoupající obavy expertů i vlád ze zneužití jejích umělých inteligencí pro účely biologické války. Na podzim vydal Bílý dům nařízení, které upozorňuje na to, že by umělé inteligence mohly snížit náročnost návrhu i výroby biologických zbraní.

Už před dvěma roky také jiný výzkum prozkoumal potenciál AI k vývoji látek nebezpečných lidem; tehdy měl program vytvořit model chemikálie co nejpodobnější nervově paralytické látce VX. Jak se ukázalo, řada vygenerovaných sloučenin byla dokonce ještě toxičtějších než VX. V důsledku toho autoři stojící za touto studií drží některé podrobnosti svého výzkumu až doposud v tajnosti – dokonce vážně diskutovali o tom, jestli tyto výsledky vůbec zveřejnit.