Vkládat slova do úst světovým politikům nebo známým celebritám. Zní to jako sci-fi, přitom k tomu stačí jen počítač a pár hodin času. Výsledná videa jen málokdo rozpozná od originálu. Zatím se tak jejich tvůrci jen baví, hrozí však, že z videomontáže se stane nový nástroj pro šíření dezinformací. Deep fake, jak se falešným nahrávkám říká, by se podle některých odborníků brzy mohly hojně šířit na sociálních sítích. Uvěří jim každý? A jak se jim dá ubránit? Tématu se věnuje dnešní vydání pořadu Newsroom ČT24, který začína ve 22:02.

„Harry Potter zavítal do Prahy. Má tady důležitý úkol. Tentokrát se musí utkat se samotným profesorem Brumbálem – v tomto případě tedy Bumbálem v podání Miloše Zemana – a získat Kámen mudrců. Bumbál ho chce totiž předat Voldemortovi, nejhrůznějšímu ze všech čarodějů. Souboj mezi Potterem a Bumbálem dopadne stejně jako ve známých filmech. Mladý kouzelník zvítězí a z Bumbála zbyde jen popelníček.“

To je ve stručnosti scénář satirického videa, které se loni masově šířilo internetem. Že jde v tomto případě o videomontáž, dokáže divák celkem snadno rozpoznat. Na síti ale kolují i videa, u kterých už to tak snadné není. Nové formě dezinformací se říká deep fake, počeštěný výraz pro tyto pokročilé videomontáže zatím neexistuje. Iluze na takových videích je takřka dokonalá.

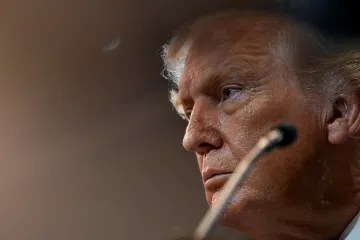

K nejznámějším příkladům patří projev bývalého amerického prezidenta Baracka Obamy. Na jedné straně monitoru je exprezident Obama, na té druhé upravené video pomocí počítačového algoritmu. Rozeznat je od sebe zvládne málokdo. „Věděl jsem, že je to možné, ale nebyl jsem si jistý, že to bude skutečně fungovat. Když jsem viděl, že ano, říkal jsem si: tohle je šílené,“ prohlásil autor videa Jared Sosa.

Stačí jen počítač a pár hodin

Výroba satirické pohádky s Harrym Potterem a Bumbálem zabrala jejím autorům asi půl roku. Pracovali se záběry Miloše Zemana, například z udílení státních vyznamenání. Z těch udělali výřezy, přidali jiná prostředí a pak si hráli s detaily. Ohledy museli brát třeba i na pohyby postav.

„Pokaždé je to jiné, ale pracuje na tom asi tak deset lidí, kteří aktivně přispívají produkci, a pak jsou samozřejmě lidi, kteří nám pomáhají třeba s rekvizitami a dalšími věcmi,“ objasňuje jeden z tvůrců Michal Orsava.

Nejnovější technologie pro tvorbu deep fake videí už však tolik času nepotřebují. Několik měsíců týmové práce zvládne program v řádu hodin. Stačí nahrát záběry a sehnat fotky, kterými chce autor svou oběť nahradit. Umělá inteligence vše propočítá a vymění. Takzvaná neuronová síť totiž během procesu zpracuje data o tvaru obličeje i o mimice. Nasbíraná data pak sama promítne přímo do záznamu.

Internetem se nejdřív šířily takto vytvořené vtipy nebo pornografie. Uživatelé třeba dosadili Nicolase Cage snad do každého známějšího filmu. Trend výměny obličejů ale postupně dorazil i do politiky. V budoucnu by tak mohl ovlivnit volby nebo i válečné konflikty. Podvod je navíc možné odhalit jen díky drobným detailům. Umělá inteligence například ještě neumí přirozeně mrkat. Je ale jen otázka času, než dokáže napodobit i tento lidský pohyb.

„Už jsme se naučili, že ne každý článek je pravda, že ne každé fotografii můžeme věřit, a teď se to začínáme učit o videonahrávkách,“ říká zakladatel webu Manipulátoři Petr Nutil. Máme tedy začít pochybovat úplně o všem, co vidíme a slyšíme? Jaká je reálná hrozba „hlubokých lží“?

A jak se proti nim bránit? Víc v nedělním Newsroomu.